Trong quá trình sử dụng các mô hình AI như Claude, nhiều người thường gặp một vấn đề quen thuộc: token bị tiêu hao nhanh, chi phí tăng cao nhưng hiệu quả chưa tương xứng. Đặc biệt với những ai làm content, marketing hay phát triển sản phẩm AI, việc tối ưu token không chỉ giúp tiết kiệm chi phí mà còn nâng cao hiệu suất làm việc đáng kể. Vậy làm thế nào để “dùng ít hơn nhưng làm được nhiều hơn”? Dưới đây là những cách tối ưu token cực kỳ thực tế và dễ áp dụng.

1. Viết prompt rõ ràng ngay từ đầu

Điểm quan trọng nhất cần hiểu là mỗi lần bạn viết prompt, bạn đang thiết kế một “bài toán” cho AI giải. Nếu bài toán mơ hồ, AI buộc phải mở rộng không gian suy đoán. Điều này khiến câu trả lời dài hơn, bao quát nhiều khả năng hơn, nhưng lại không tập trung vào mục tiêu bạn thực sự cần. Hệ quả là bạn phải tiếp tục chỉnh sửa, hỏi lại, hoặc yêu cầu viết lại từ đầu. Chính chuỗi lặp này mới là thứ “đốt token” nhiều nhất, chứ không phải một câu trả lời dài.

Vì vậy, khi viết prompt rõ ràng ngay từ đầu, bạn đang làm một việc rất quan trọng: thu hẹp không gian suy luận của AI. Thay vì để mô hình tự quyết định về độ dài, giọng văn, đối tượng hay mục tiêu nội dung, bạn định nghĩa sẵn tất cả. Điều này không chỉ giúp câu trả lời chính xác hơn mà còn giảm đáng kể số lần phải tương tác lại. Nói cách khác, bạn đang chuyển chi phí từ nhiều lần sai thành một lần đúng.

Ví dụ: Thay vì: “Viết giúp tôi một bài về marketing, càng chi tiết càng tốt”. Hãy viết: “Viết bài 800 chữ về chiến lược content marketing cho Gen Z, giọng văn trẻ trung, có ví dụ thực tế tại Việt Nam”

Prompt càng cụ thể, output càng đúng → giảm số lần chỉnh sửa → tiết kiệm token.

2. Kiểm soát đầu ra (Output Token)

Đôi khi Claude quá "nhiệt tình" giải thích khiến bạn tốn token không cần thiết. Hãy giới hạn nó bằng các câu lệnh điều hướng:

- Yêu cầu trực diện: "Chỉ trả về mã nguồn, không giải thích thêm".

- Giới hạn định dạng: "Trả lời dưới dạng bảng hoặc gạch đầu dòng ngắn gọn".

- Bỏ qua lời chào: "Đi thẳng vào vấn đề, bỏ qua các câu xã giao như 'Tôi có thể giúp gì...'".

3. Sử dụng CLAUDE.md cho dự án dài hạn

Nếu bạn dùng Claude để lập trình hoặc viết lách dài hạn, hãy tạo một file CLAUDE.md (hoặc dùng tính năng Project Instructions trên bản Pro).

Thay vì mỗi lần đều nhắc lại: "Hãy viết code bằng Python, dùng thư viện FastAPI, đặt tên biến theo chuẩn snake_case", bạn chỉ cần ghi tất cả vào phần hướng dẫn chung. Claude sẽ luôn ghi nhớ mà không cần bạn phải dán lại trong mỗi Prompt.

4. Chiến thuật dành cho Developer (API)

Nếu bạn đang sử dụng Claude qua API, đây là hai "vũ khí" tối thượng:

- Prompt Caching: Tính năng này cho phép bạn lưu trữ các đoạn văn bản lớn (như tài liệu hướng dẫn hoặc codebase) vào bộ nhớ đệm. Bạn chỉ phải trả phí đầy đủ cho lần đầu, các lần sau phí sẽ giảm tới 90%.

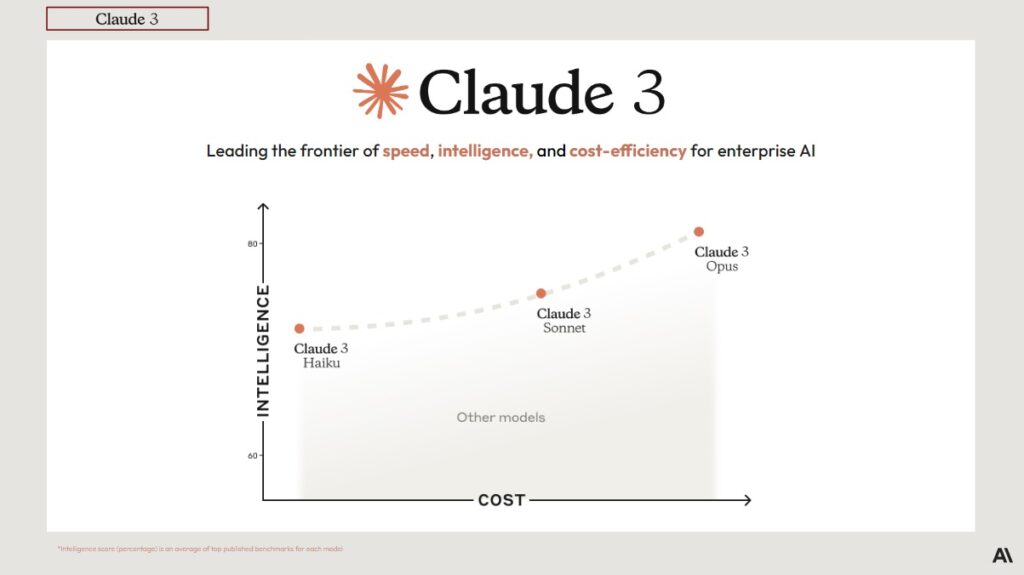

- Chọn Model phù hợp:

- Haiku 3.5: Câu trả lời nhanh, tóm tắt và trích xuất đơn giản - bất cứ điều gì bạn muốn thực hiện ngay lập tức

- Sonnet 3.5: Lập trình, viết lách, phân tích và quy trình làm việc nhiều bước - công cụ mặc định đa năng

- Opus: Nghiên cứu chuyên sâu và lập luận phức tạp, thực sự cần sự suy nghĩ bền bỉ

Tựu trung lại, tối ưu token không phải là việc cắt giảm một cách cơ học, mà là quá trình tối ưu toàn bộ cách bạn làm việc với AI. Nó bắt đầu từ việc suy nghĩ rõ ràng hơn, tiếp tục bằng việc kiểm soát đầu ra, và đạt đến mức cao nhất khi bạn thiết kế được một hệ thống sử dụng AI hiệu quả. Khi đó, bạn không còn phụ thuộc vào việc thử-sai nhiều lần, mà chuyển sang trạng thái chủ động, nơi mỗi lần tương tác đều mang lại giá trị tối đa.

Khi hiểu đúng bản chất này, bạn sẽ nhận ra rằng việc “dùng ít hơn nhưng làm được nhiều hơn” không phải là một mẹo nhỏ, mà là kết quả của một tư duy vận hành thông minh. Và chính tư duy đó mới là yếu tố tạo ra sự khác biệt rõ rệt giữa người chỉ sử dụng AI và người thực sự khai thác được sức mạnh của nó.

.jpg)